Los robots humanoides llevan años prometiendo una revolución silenciosa en los hogares: máquinas con forma humana capaces de asumir tareas cotidianas, interactuar con su entorno y convivir con las personas como si fueran un electrodoméstico avanzado. La carrera por construir ‘ayudantes universales’ ha llegado incluso a España y tiene ya un abanico de posibilidades interesante, pero una de las empresas que más destaca esFigure AI.

Esta compañía californiana, fundada por Brett Adcock, se ha convertido en una de las caras visibles de la nueva generación de asistentes mecánicos.

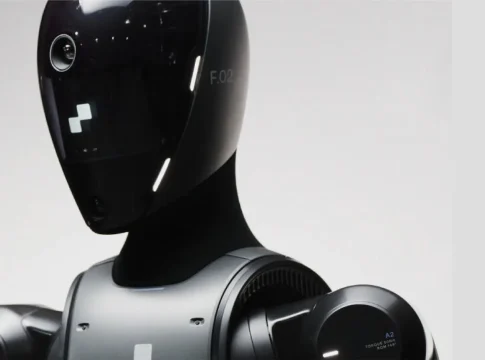

Su propuesta se articula en torno a tres generaciones de robots: Figure 01, su primer prototipo; Figure 02, un modelo más avanzado centrado en manipulación precisa; y Figure 03, la evolución más reciente pensada para producción a gran escala y futuros hogares.

Su objetivo es que estos robots se integren en la vida diaria sin fricciones. Su riesgo, como acaba de descubrirse, la potencia que esconden bajo su esqueleto metálico.

En pleno auge del interés por los humanoides —impulsado también por avances en IA generativa y mejoras en la movilidad autónoma—, un nuevo escándalo vuelve a poner el foco en la seguridad de estas máquinas. Y esta vez procede de dentro de la propia compañía.

El exresponsable de seguridad denuncia que el Figure 02 puede fracturar un cráneo humano

El 21 de noviembre de 2025, Robert Gruendel —exresponsable de seguridad de producto en la compañía— presentó una demanda federal en California acusando a Figure AI de ignorar advertencias críticas sobre la potencia real de sus robots. Según su declaración, el modelo en el centro del problema es el Figure 02, un humanoide capaz de generar una fuerza suficiente como para fracturar el cráneo de un adulto en caso de impacto directo.

Gruendel relata que, durante las pruebas internas, uno de los robots golpeó accidentalmente un frigorífico con la fuerza suficiente como para abollarlo, un incidente que, de haber ocurrido contra una persona, habría tenido consecuencias graves. Asegura también que tanto el CEO, Brett Adcock, como el ingeniero jefe, Kyle Edelberg, minimizaron estos riesgos incluso después de una ronda de financiación multimillonaria y que su propuesta de hoja de ruta de seguridad fue directamente eliminada.

Poco después de elevar sus advertencias, Gruendel fue despedido. Él sostiene que se trata de una represalia, mientras la empresa defiende que la decisión responde a bajo rendimiento. Más allá del conflicto laboral, la denuncia apunta a un problema de fondo: la posibilidad de que un robot doméstico en apariencia inofensivo pueda ejecutar movimientos con fuerza letal.

¿Qué dice la denuncia?

La denuncia señala que, desde el inicio, no existían procedimientos formales de seguridad, informes de incidentes o evaluación de riesgos específicos. El único responsable externo de seguridad era un contratista sin experiencia en robótica.

Según Gruendel, los directivos toleraban fallos, descartaron en una fase previa controles clave como un botón de paro de emergencia (E-Stop) porque “no gustaban estéticamente” y modificaron el plan de seguridad antes de presentarlo a inversores, lo que él interpreta como una práctica potencialmente fraudulenta.

Qué afirma Figure AI

La compañía rechaza por completo la versión del exingeniero. En su respuesta oficial, Figure AI asegura que las acusaciones son “falsas” y que planea defenderse “con firmeza” en los tribunales. Según la empresa, el despido de Robert Gruendel no tuvo nada que ver con sus advertencias de seguridad, sino con un supuesto bajo rendimiento en su puesto.

En sus comunicados, la firma insiste en que su equipo trabaja bajo estándares rigurosos y que la seguridad forma parte del diseño de cada uno de sus modelos. También subraya que el denunciante está presentando una imagen distorsionada del proceso interno con afirmaciones que, según ellos, no reflejan la realidad del desarrollo del robot Figure 02, el humanoide cuestionado en la denuncia.

Figure AI se defiende argumentando que está inmersa en un proceso de innovación acelerada, pero niega rotundamente haber recortado controles esenciales o desestimado deliberadamente riesgos en sus robots. Para la compañía, la demanda es un intento de desacreditar su trabajo en un momento de alta visibilidad mediática.

La llegada de los humanoides al hogar abre un debate urgente sobre seguridad

Figure AI aspira a desplegar decenas de miles de sus modelos —incluido el aún más avanzado Figure 03— en entornos reales en los próximos años. Pero este caso expone los riesgos de acelerar la adopción de humanoides sin un marco claro de supervisión externa. Para mover peso, manipular objetos y operar con precisión, estos robots necesitan motores potentes… y esa misma potencia puede representar un peligro si algo falla o si el diseño no incorpora frenos y controles redundantes.

El caso del Figure 02 ilustra esa tensión entre innovación y seguridad. Si un robot capaz de convivir en un salón puede, en determinadas circunstancias, generar fuerza suficiente para causar lesiones graves, la conversación sobre normativas, auditorías y responsabilidades se vuelve inevitable. La industria avanza rápido, pero la legislación y los protocolos de seguridad aún van por detrás.